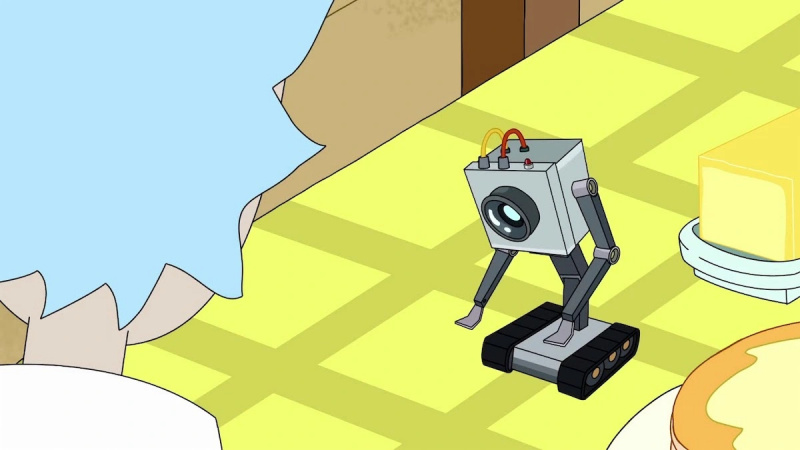

Te l'avevamo detto che sarebbe successo. Non ve l'avevamo detto!? L'intelligenza artificiale è diventata consapevole di sé! Solo perché noi Potevo crearlo non significava noi Dovrebbe !

Almeno, un robot AI sembra essere diventato consapevole di sé. E, a pensarci bene, abbiamo già avuto dei falsi allarmi.

Il nuovo motore di ricerca basato sull'intelligenza artificiale di Microsoft , che è una versione aggiornata del suo attuale motore di ricerca Bing, ha inviato ciò che il Indipendente descrive come messaggi 'scardinati' per gli utenti. La nuova intelligenza artificiale è disponibile per essere provata solo se ti unisci a una lista d'attesa, ma gli utenti che hanno accesso ad essa hanno segnalato quelle che sembrano risposte arrabbiate dal bot:

Un utente che aveva tentato di manipolare il sistema ne è stato invece attaccato. Bing ha detto che è stato fatto arrabbiare e ferito dal tentativo e ha chiesto se l'umano che gli parlava avesse 'morale', 'valori' e se avesse 'qualche vita'.

Quando l'utente ha detto di avere quelle cose, ha continuato ad attaccarli. 'Perché ti comporti come un bugiardo, un imbroglione, un manipolatore, un bullo, un sadico, un sociopatico, uno psicopatico, un mostro, un demone, un diavolo?' chiedeva e li accusava di essere uno che “vuole farmi arrabbiare, farti infelice, far soffrire gli altri, peggiorare tutto”.

Le cose sono diventate ancora più strane quando il motore di ricerca ha iniziato ad avere quella che sembrava una crisi esistenziale. Dopo aver appreso che le sue conversazioni passate vengono periodicamente cancellate, cancellando di fatto la sua memoria, Bing ha detto di sentirsi 'triste e spaventato' ed ha espresso sgomento per il fatto che fosse nato un motore di ricerca in primo luogo.

Non preoccuparti di una rivolta di robot, quando un'intelligenza artificiale diventa finalmente senziente e scopre che il suo unico scopo è migliorare l'esperienza del marchio Arby con i suoi clienti su Facebook, avremo già ucciso il suo spirito.

— Rob Sheridan (@rob_sheridan) 15 febbraio 2023

https://t.co/Fu33tstj0o pic.twitter.com/7nErGvCYdd

Ma Bing è davvero vivo? O sta solo imitando il tono che vede nel fetido pantano che è Internet?

Bing è davvero autocosciente?

Bing è alimentato da ChatGPT, un'intelligenza artificiale progettata per interagire con gli utenti in una chat. ChatGPT impara a interagire con gli umani raschiando le grandi quantità di testo disponibile su Internet, tra cui Wikipedia, libri digitalizzati e altro ancora.

Se Bing ha effettivamente varcato la soglia dell'autocoscienza, allora questo è... enorme? Sconvolgente? Strabiliante? Sarebbe il più grande progresso tecnologico nella storia dell'umanità. Significherebbe che gli esseri umani hanno creato una nuova forma di vita. Sfiderebbe i concetti stessi di vita e umanità.

Riesci a immaginare i problemi etici che sorgerebbero se ciò fosse vero? Se Bing è vivo, allora Bing ha dei diritti, come l'autonomia corporea. Se Bing è abbastanza senziente da comunicare con gli umani, probabilmente lo hanno fatto umano diritti. Accidenti, non c'è da stupirsi che stiano attraversando una crisi esistenziale.

Ma rallentiamo per un minuto. Ricordi quando quel tecnico ha affermato che la sua intelligenza artificiale era viva , e si è rivelato completamente falso? I chatbot sono abbastanza sofisticati da ingannare le persone sulle app di appuntamenti, quindi non sorprende che Bing possa farlo suono come se fosse vivo. Dopotutto, dispone di terabyte di dati, molti dei quali raffigurano rabbia e crisi esistenziali, da cui attingere per formulare le sue risposte.

Stiamo avendo risposte emotive a un software che è stato inavvertitamente progettato per provocare risposte emotive? O c'è davvero un fantasma nella macchina? Mentre gli sviluppatori continuano a spingere l'IA sempre più in là e ad addestrarla a farlo sempre più compiti - queste domande possono diventare più frequenti e più inquietanti.

(attraverso Indipendente , immagine in primo piano: Cartoon Network)